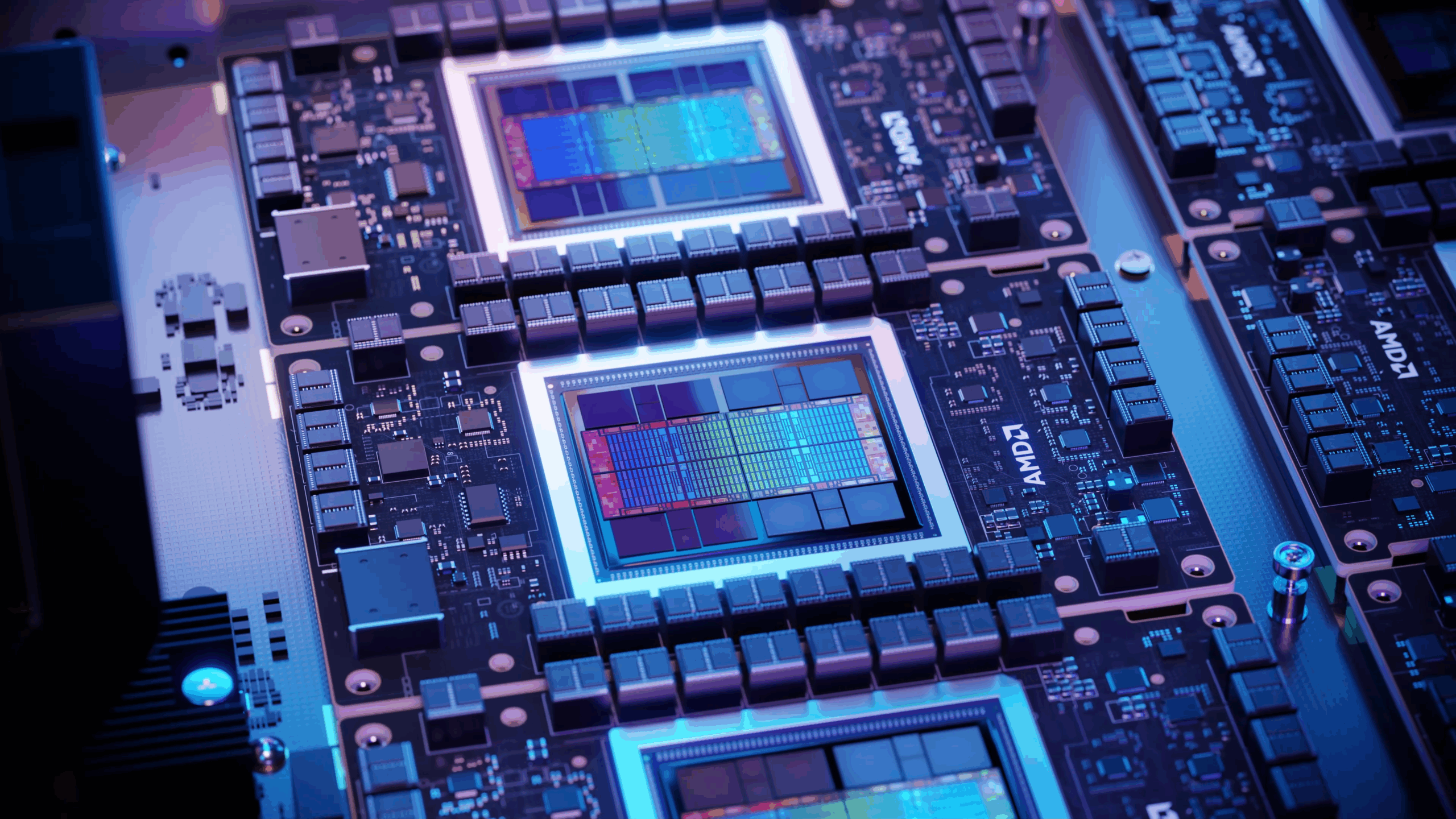

A AMD deu um passo decisivo na corrida pelos aceleradores de inteligência artificial ao iniciar o envio de amostras das primeiras GPUs Instinct MI450 para clientes selecionados. Durante a teleconferência de resultados do primeiro trimestre de 2026, a Dra. Lisa Su confirmou que os novos chips, baseados na arquitetura CDNA 5, seguem o cronograma para implantação em larga escala no segundo semestre deste ano dentro da plataforma de rack Helios.

A demanda já superou as expectativas internas da companhia para 2027, impulsionada por contratos de vários gigawatts com gigantes como OpenAI e Meta. Embora a série MI450 seja altamente capaz em treinamento, a AMD destaca que as maiores implementações serão voltadas para a inferência, setor onde a IA agêntica tem exigido um volume massivo de processamento em tempo real.

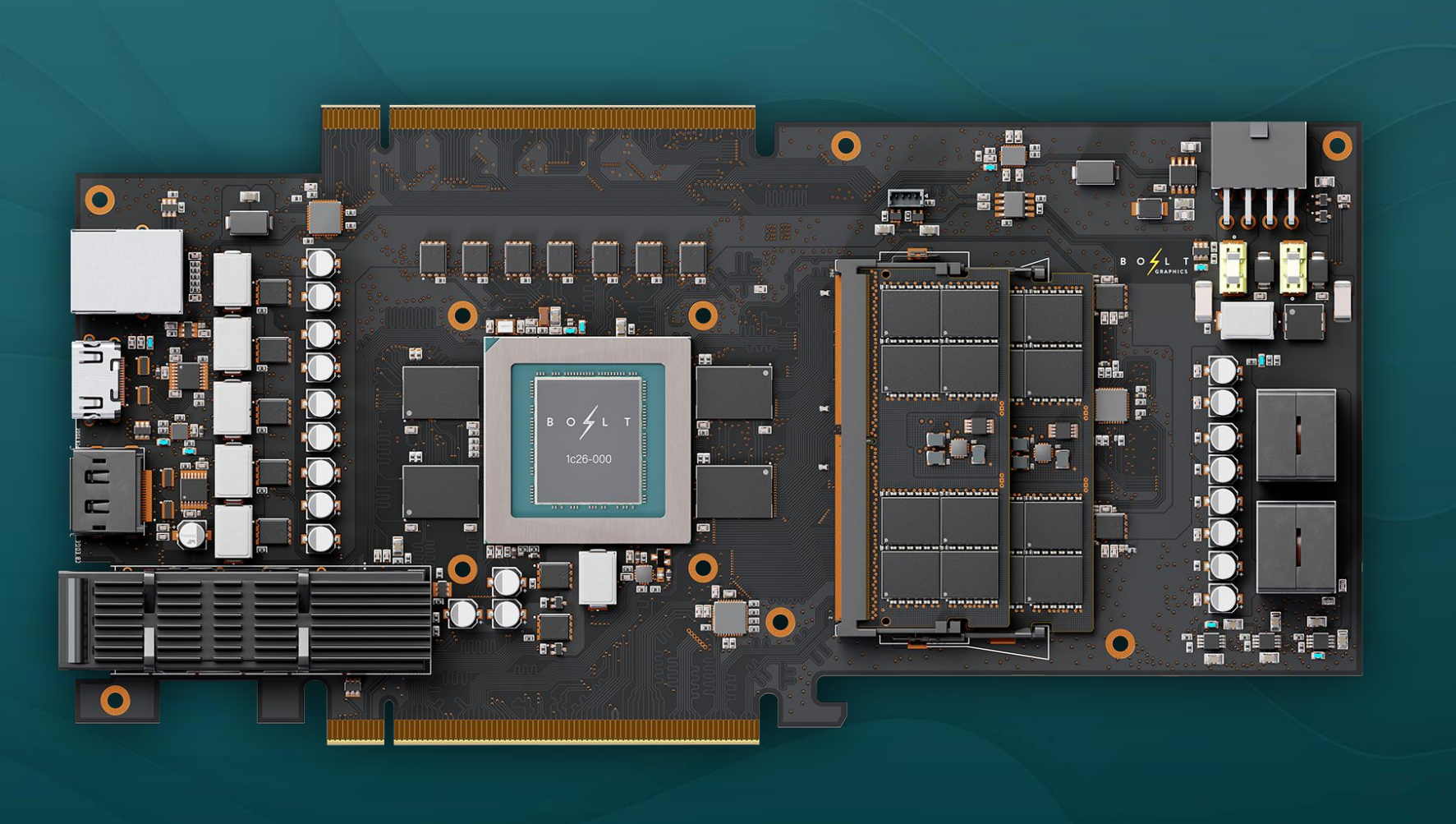

Especificações técnicas e arquitetura CDNA 5

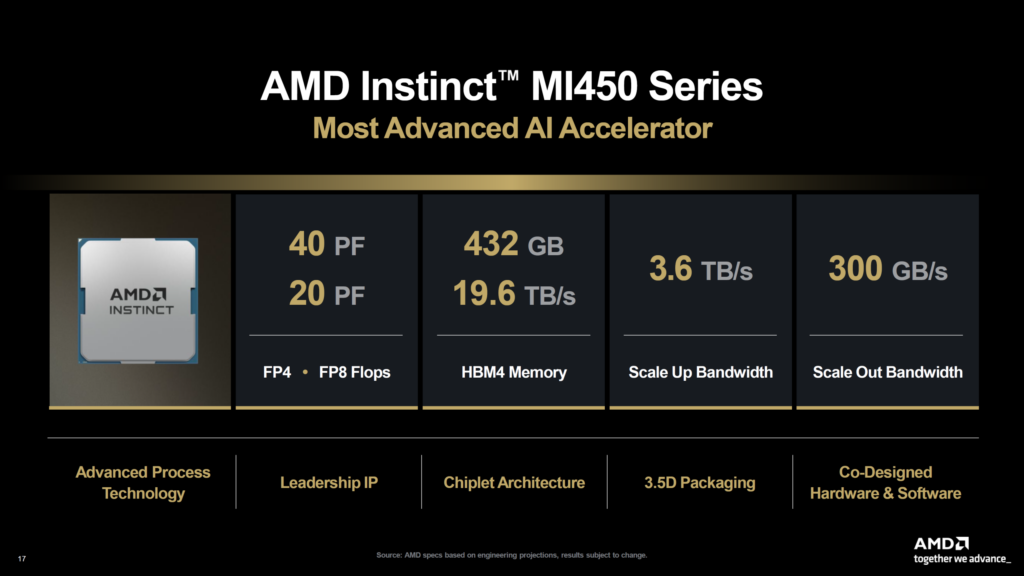

A série Instinct MI400 traz avanços significativos em poder computacional e memória, utilizando o novo padrão HBM4 para romper gargalos de largura de banda.

| Recurso | MI350 (Geração Atual) | MI450 (Próxima Geração) | Impacto |

| Capacidade de Memória | 288 GB HBM3e | 432 GB HBM4 | Aumento de 50% para modelos de IA maiores. |

| Largura de Banda de Memória | 8 TB/s | 19,6 TB/s | Mais que o dobro de velocidade na transferência de dados. |

| Desempenho FP4 | 20 PFLOPs | 40 PFLOPs | Dobro da capacidade de computação para IA. |

| Desempenho FP8 | 10 PFLOPs | 20 PFLOPs | Evolução direta na eficiência de treinamento e inferência. |

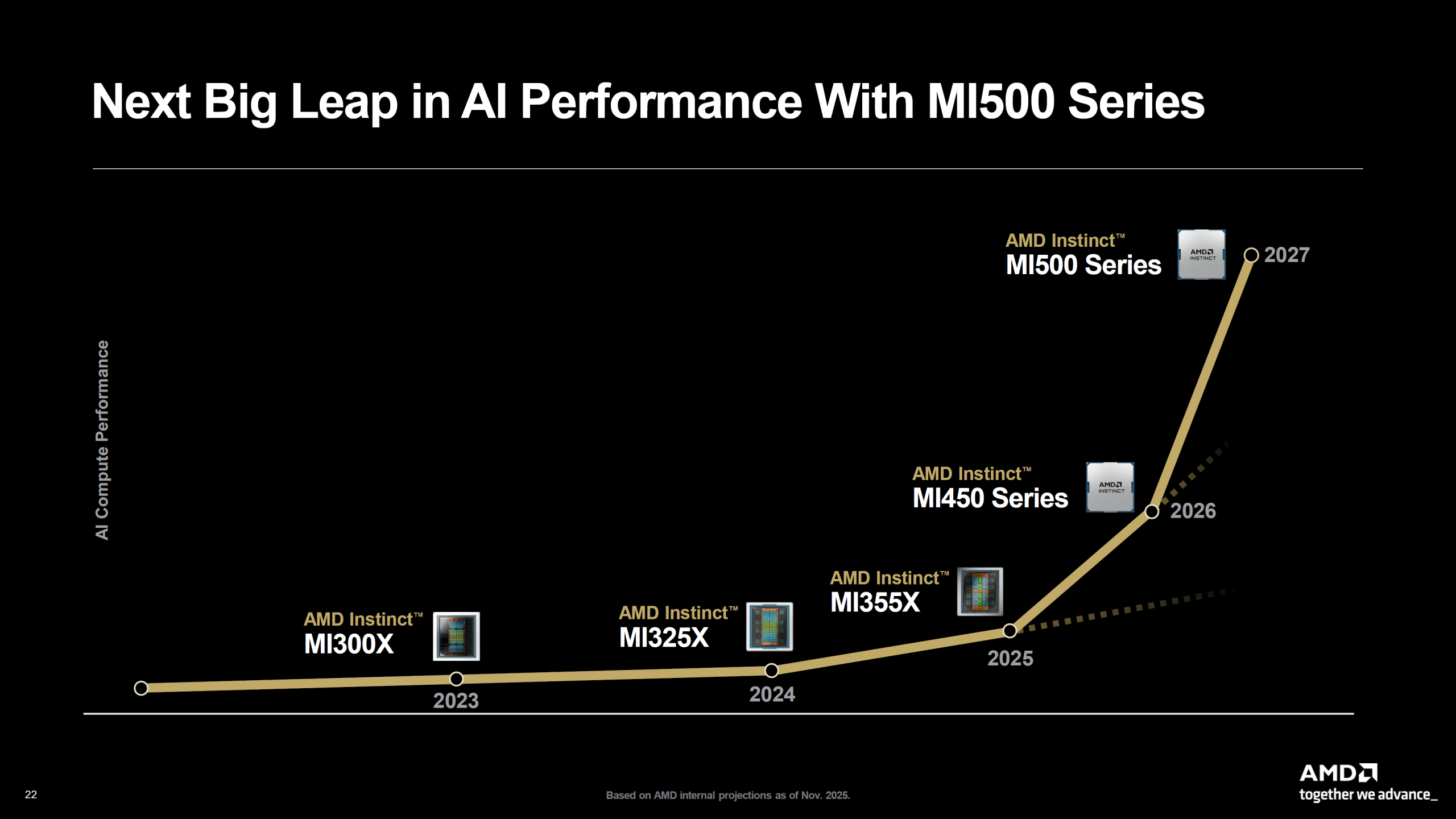

Estratégia de mercado e série MI500

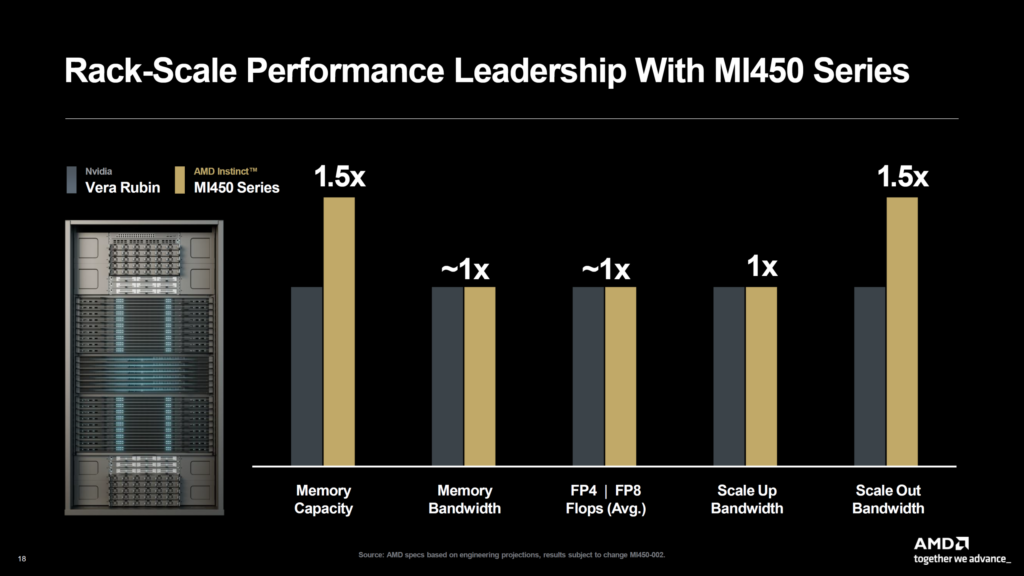

A AMD posicionou a MI455X diretamente contra a arquitetura Vera Rubin da NVIDIA, destacando uma capacidade de memória 1,5 vez superior à da concorrente. Além da MI455X voltada para data centers de hiperescala, a empresa lançará a MI430X, focada em computação de alto desempenho (HPC) e IA soberana, com suporte a cálculos de alta precisão (FP64) em hardware.

Enquanto a MI450 entra em fase de produção, o interesse dos clientes já se estende à futura série MI500. Grandes players do setor estão em fase de engenharia conjunta com a AMD para planejar a próxima fase da infraestrutura de IA, buscando alternativas que ofereçam melhor custo total de propriedade e maior largura de banda de expansão horizontal.

Próximos passos na infraestrutura de IA

A integração no rack Helios permite que a AMD ofereça soluções completas em escala, utilizando padrões de rede abertos como UALoE e UEC. Esta abordagem facilita a orquestração de milhares de GPUs em um único cluster, algo essencial para as cargas de trabalho de inferência que sustentam os novos assistentes e agentes inteligentes.

Mais detalhes sobre a plataforma RackScale, as especificações finais das GPUs de próxima geração e os avanços nos processadores EPYC serão compartilhados no evento Advancing AI, agendado para julho deste ano.

Fonte da matéria: WCCFtech

Siga o TecLab em todas as mídias: linktr.ee/rbuass

Galindowie • 7 de maio de 2026 às 13:19 GMT-3

0 comentários