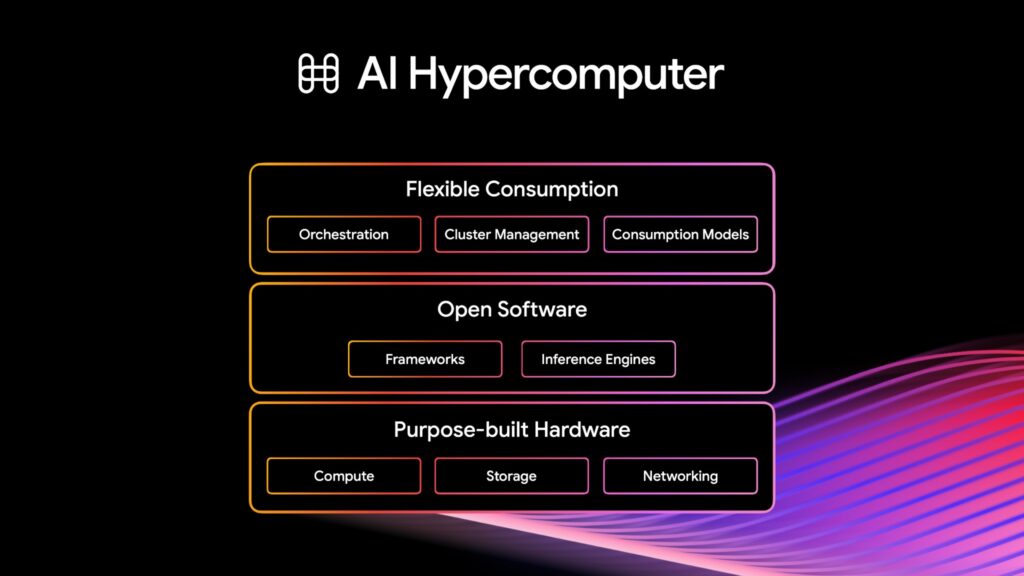

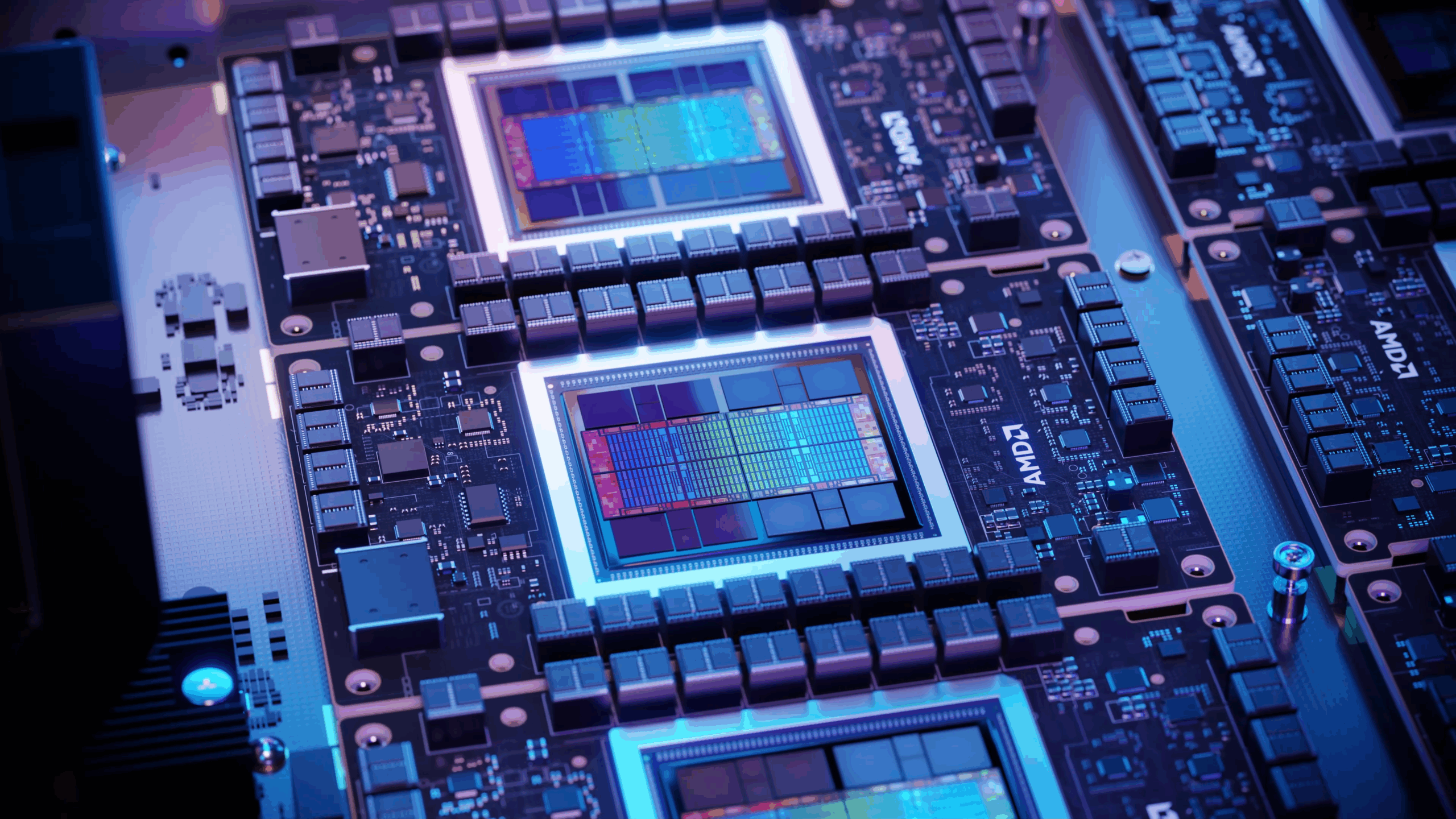

O Google revelou formalmente seu Hipercomputador de IA, uma arquitetura de datacenter projetada especificamente para unificar computação, armazenamento e rede em uma escala sem precedentes. O objetivo é sustentar a transição dos modelos de linguagem tradicionais para os Agentes de IA, sistemas capazes de raciocinar e agir de forma autônoma.

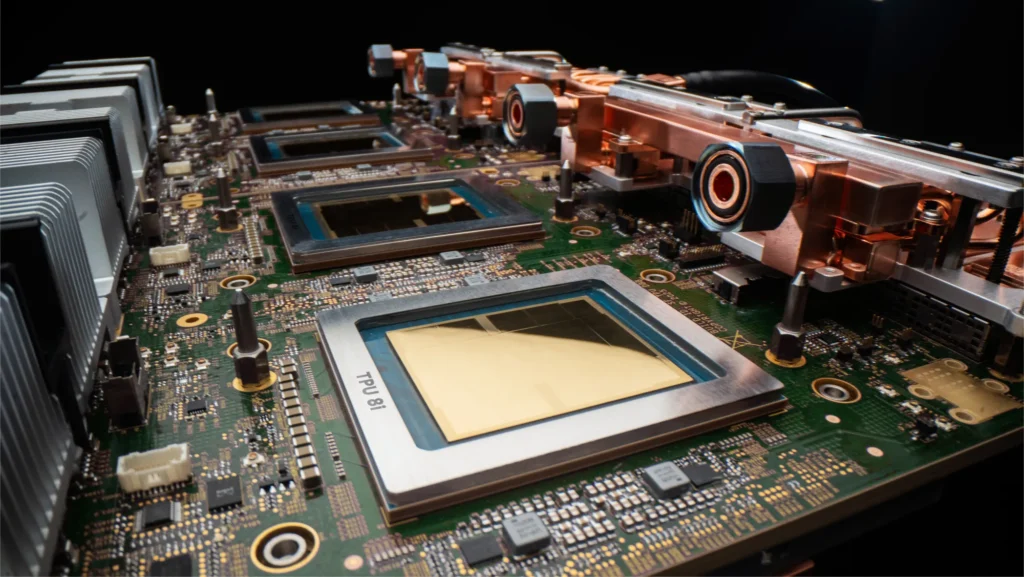

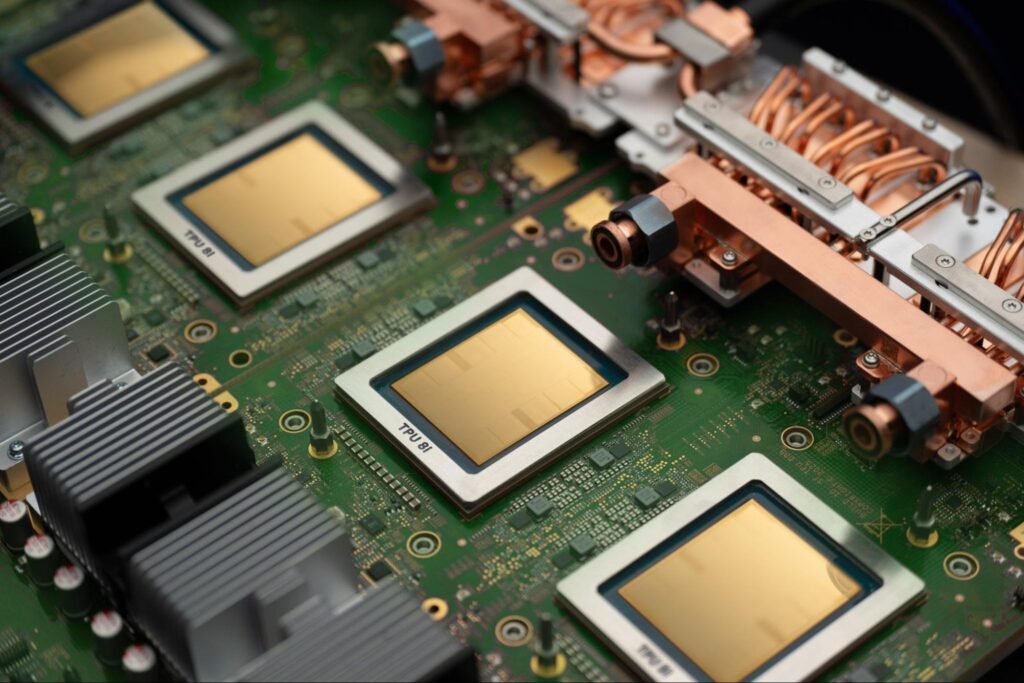

A espinha dorsal dessa infraestrutura é a nova 8ª geração de TPUs (Tensor Processing Units), que chega em duas variantes especializadas para otimizar o Custo Total de Propriedade (TCO).

Google TPU 8t: A potência do treinamento

O chip TPU 8t foi desenvolvido para reduzir o tempo de treinamento de modelos de ponta de meses para semanas. Ele introduz o suporte nativo ao formato FP4 (ponto flutuante de 4 bits), dobrando a taxa de transferência e minimizando a movimentação de dados.

- Escalabilidade: Um único superpod escala para 9.600 chips e 2 PB de memória compartilhada.

- Desempenho: Entrega 121 ExaFlops de poder computacional (FP4), sendo 2,7 vezes mais eficiente por dólar que a geração anterior (Ironwood).

- Rede Virgo: Permite escalabilidade quase linear para até um milhão de chips em um único cluster lógico.

Google TPU 8i: Especialista em inferência e raciocínio

Para a fase de serviço e resposta (inferência), o Google introduziu o TPU 8i. Com foco em modelos de Mistura de Especialistas (MoE), o chip triplica a capacidade de memória SRAM integrada para manter modelos ativos inteiramente no silício.

- Memória: Equipado com 288 GB de HBM e 384 MB de SRAM.

- Arquitetura Boardfly: Reduz a latência da rede em 50%, garantindo que 1.152 TPUs operem como uma unidade coesa.

- Eficiência: Oferece um desempenho 80% melhor por dólar em tarefas de baixa latência.

Comparativo Técnico: TPU 8t vs. TPU 8i

| Recurso | TPU 8t (Treinamento) | TPU 8i (Inferência) |

| Carga de Trabalho | Pré-treinamento em larga escala | Amostragem e Raciocínio |

| Pico de PFLOPs (FP4) | 12.6 | 10.1 |

| Capacidade HBM | 216 GB | 288 GB |

| SRAM Integrada | 128 MB | 384 MB |

| Largura de Banda HBM | 6.528 GB/s | 8.601 GB/s |

| Topologia de Rede | Toroide 3D | Boardfly |

| CPU Associada | Google Axion (Arm) | Google Axion (Arm) |

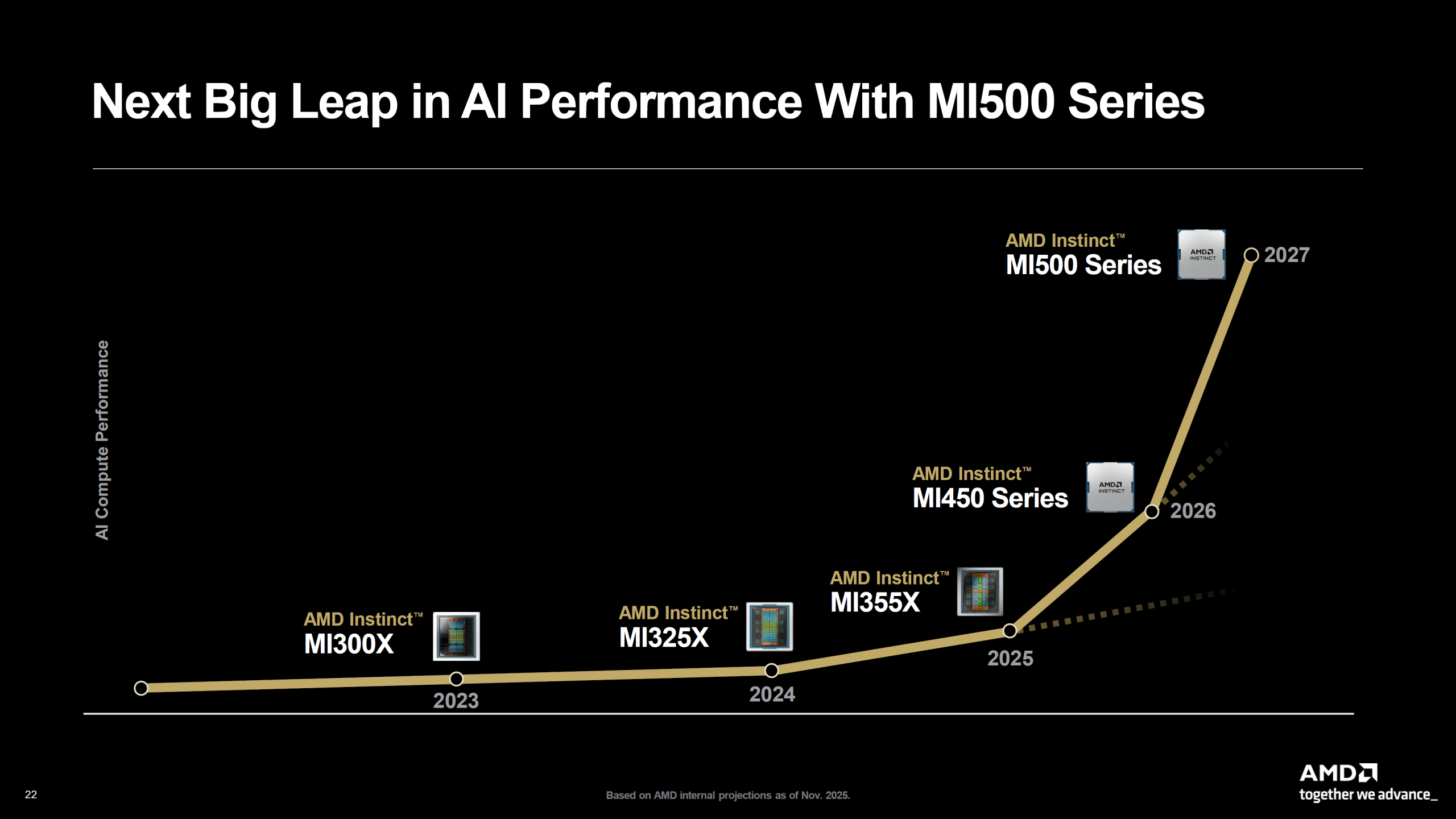

Integração com NVIDIA Rubin e CPUs Axion

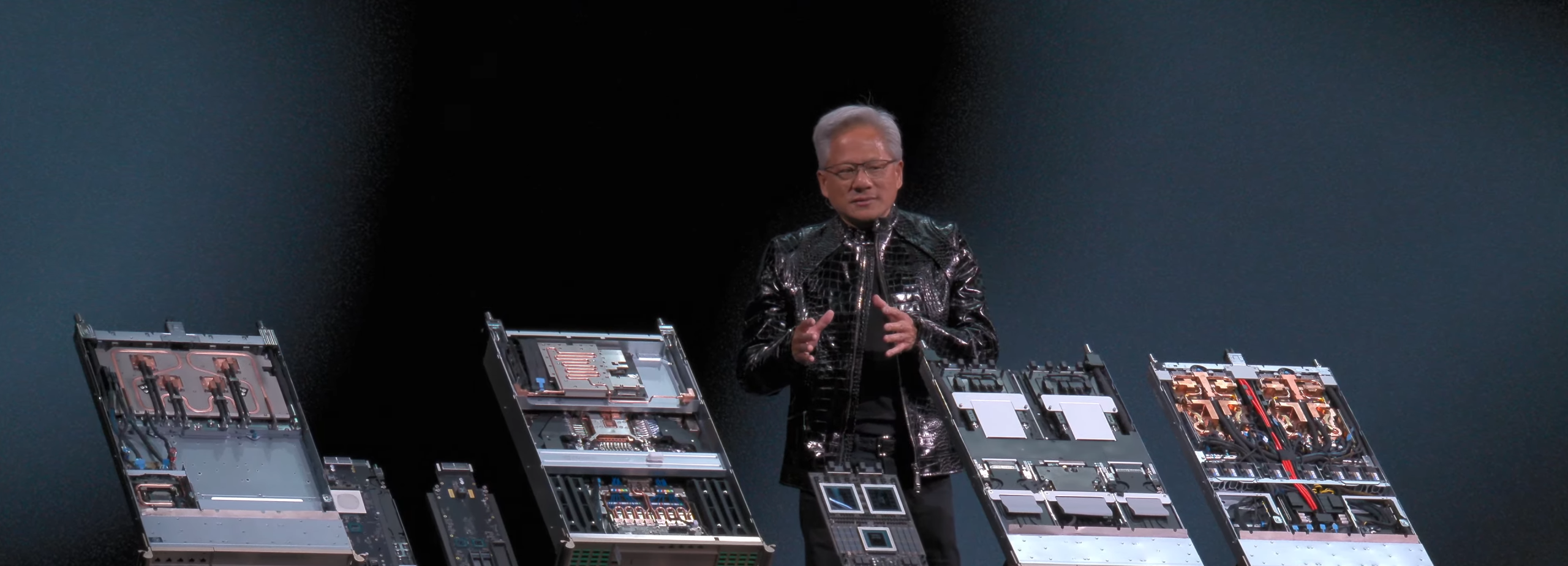

O Hipercomputador de IA não se limita ao hardware proprietário do Google. A empresa será uma das primeiras a oferecer instâncias baseadas na NVIDIA Vera Rubin NVL72, integrando-as à sua nova rede Virgo.

Além disso, a computação é apoiada pelas CPUs Axion baseadas em arquitetura Arm, que oferecem uma relação custo-benefício 100% superior a instâncias x86 tradicionais. Para sustentar esse hardware, o Google utiliza sua 4ª geração de resfriamento líquido, essencial para manter as densidades térmicas exigidas pela IA Agêntica.

Grandes instituições como o Departamento de Energia dos EUA e a Boston Dynamics já estão entre os primeiros adotantes dessa infraestrutura, que promete transformar a forma como as empresas constroem e operam sistemas de inteligência artificial em 2026.

Fonte da matéria: WCCFtech

Siga o TecLab em todas as mídias: linktr.ee/rbuass

Galindowie • 22 de abril de 2026 às 12:43 GMT-3

0 comentários