A OpenAI revelou nesta segunda-feira, 16 de fevereiro de 2026, que seu modelo de programação mais recente, o GPT-5.3-Codex-Spark, está sendo executado na infraestrutura da Cerebras. A parceria marca a primeira adoção em massa do Wafer Scale Engine 3 (WSE-3) pelo laboratório de IA e sinaliza a busca por uma alternativa robusta à NVIDIA para cargas de trabalho de inferência que exigem baixíssima latência.

Graças à arquitetura de escala de wafer da Cerebras, o Codex-Spark atingiu a marca de 1.000 tokens por segundo (TPS), uma velocidade que a OpenAI descreve como equivalente à capacidade de resposta de um “programador humano em dupla”.

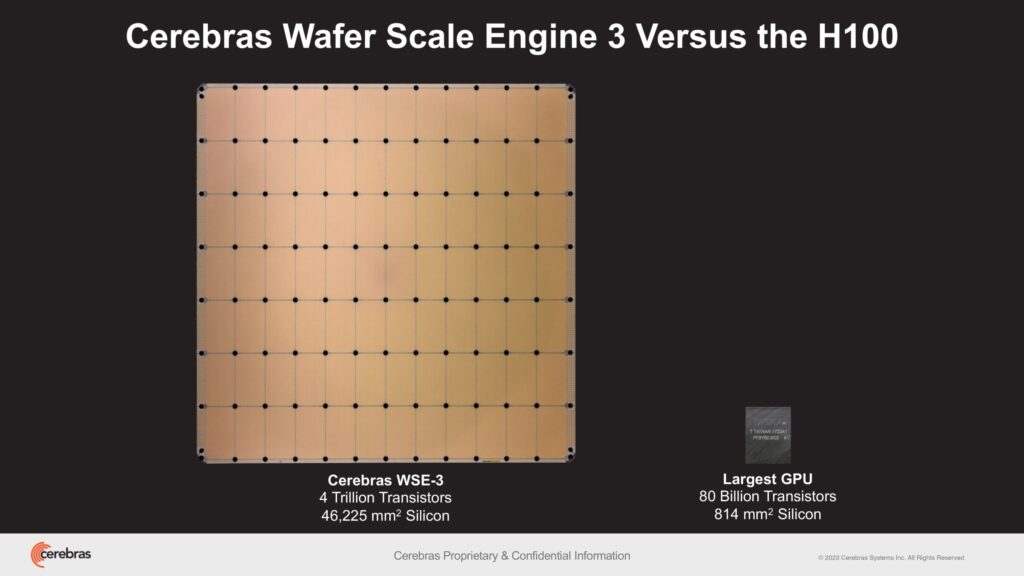

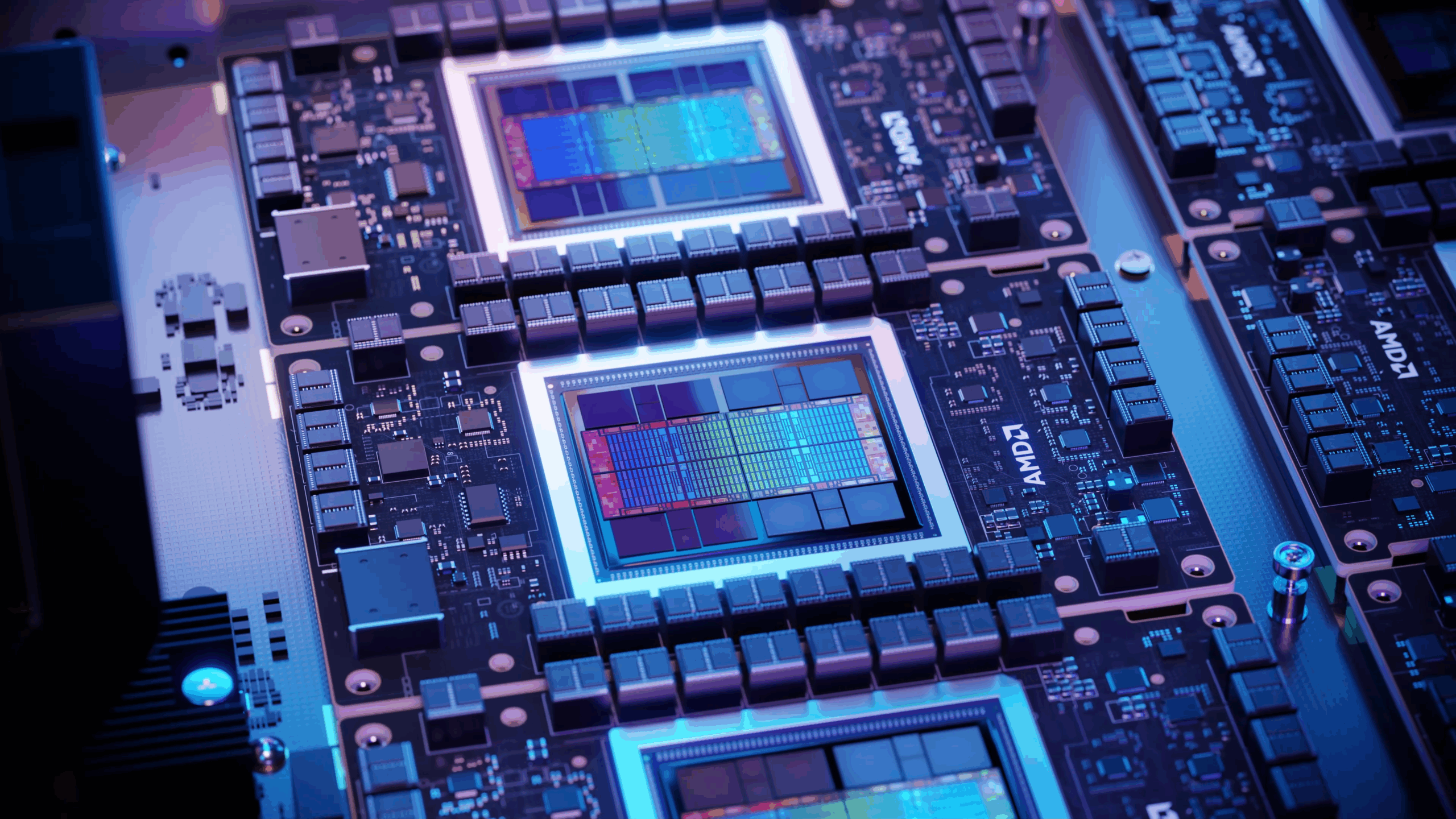

WSE-3: A quebra do gargalo de memória

A escolha pelo hardware da Cerebras justifica-se pela largura de banda massiva de 21 PB/s, fundamental para modelos de codificação onde o acesso rápido à memória é mais crítico do que o processamento bruto em lote.

- Latência Reduzida: A OpenAI afirma ter reduzido o tempo até o primeiro token em 50%. Enquanto as GPUs Blackwell da NVIDIA priorizam o rendimento (throughput) em lote, o WSE-3 foca na execução instantânea.

- Economia de Escala: Treinar e rodar o Codex-Spark na infraestrutura tradicional seria financeiramente inviável devido às limitações de largura de banda das GPUs atuais.

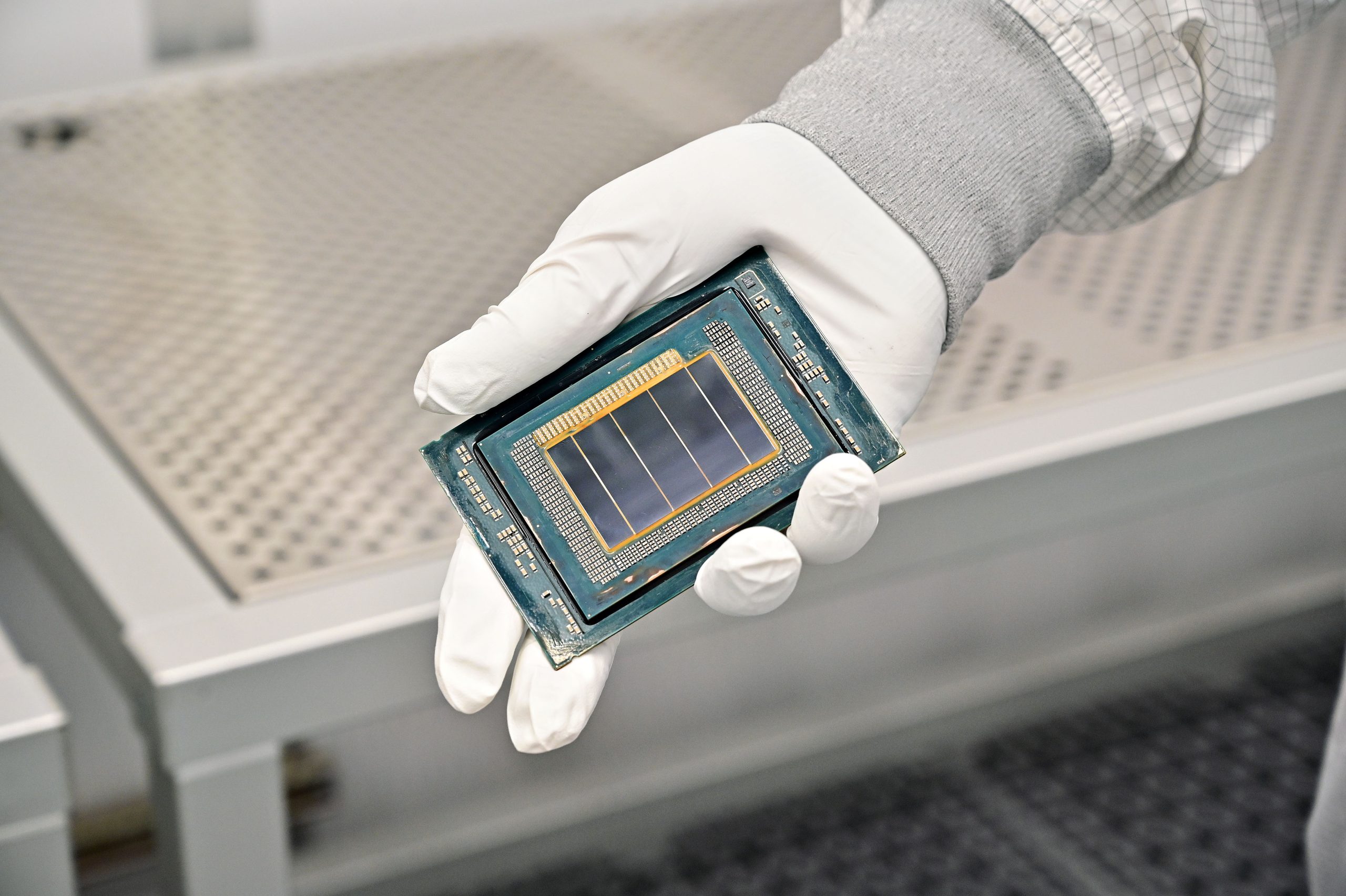

- Hardware Gigante: O WSE-3 é um chip único do tamanho de um wafer de silício completo, contendo 900.000 núcleos otimizados para IA e 44 GB de SRAM integrada.

Especificações Técnicas: Cerebras WSE-3

| Componente | Detalhes do Wafer Scale Engine 3 |

| Processo de Fabricação | TSMC 5nm |

| Transistores | ~4 trilhões |

| Núcleos de Computação | 900.000 núcleos de IA |

| Largura de Banda (On-chip) | 21 PB/s |

| SRAM Integrada | 44 GB |

NVIDIA vs. Cerebras no mercado de inferência

Apesar da adoção da Cerebras, a OpenAI reforçou que sua lealdade computacional principal permanece com a NVIDIA. Sachin Katti, executivo da OpenAI, descreveu a infraestrutura da Cerebras como uma “capacidade complementar” voltada especificamente para casos de uso onde a latência é o maior obstáculo.

A NVIDIA continua dominando a “tokenomics” global com reduções de custo de até 10 vezes na linha Blackwell, mas o sucesso do Codex-Spark prova que há espaço para competidores de ASICs e rivais como a AMD no segmento de inferência de tempo real. Para os desenvolvedores que utilizam o Codex em seus notebooks e estações de trabalho, o novo modelo “Spark” promete transformar a experiência de autocompletar código em algo verdadeiramente instantâneo e sem interrupções.

Fonte da matéria: WCCFtech

Siga o TecLab em todas as mídias: linktr.ee/rbuass

Galindowie • 16 de fevereiro de 2026 às 00:50 GMT-3

0 comentários